Thinking Machines Lab بحث يُحسِّن استجابات الذكاء الصناعي

مختبر Thinking Machines بقيادة Mira Murati نشر بحثًا يهدف إلى جعل استجابات نماذج الذكاء الاصطناعي أكثر اتّساقًا وتوقّعًا، مع أول خطوة نحو مشاركة العمل بشكل مفتوح.

التفاصيل

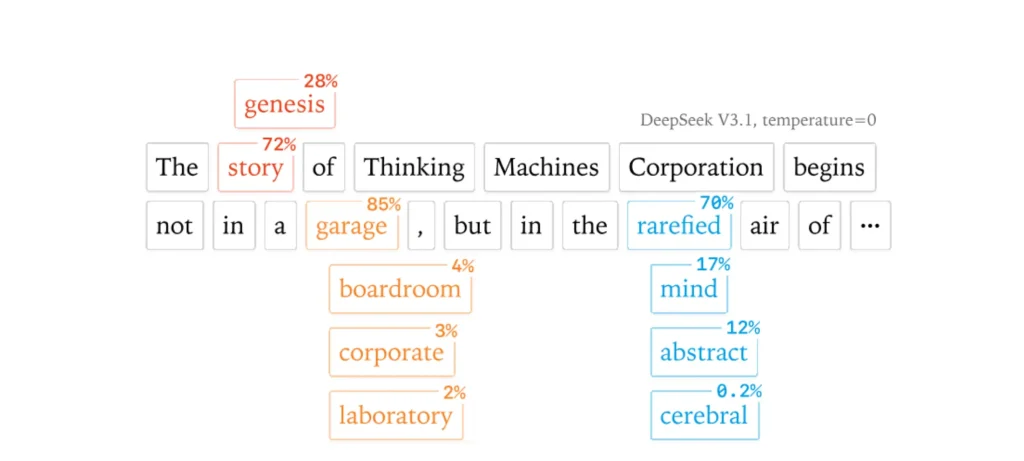

يركّز البحث الجديد على حل مشكلة عدم الحتمية في استجابات نماذج اللغة الكبيرة.

- البحث بعنوان “Defeating Nondeterminism in LLM Inference”، من تأليف Horace He.

- المشكلة تكمن في أن نفس الاستعلام ينتج إجابات مختلفة بسبب تنفيذ العمليات على وحدات GPU.

- الحل اعتمد على جعل العمليات الحسابية أكثر ثباتًا مثل batch invariance.

- النتائج أثبتت أن 1000 تشغيل للموجه أعطت نفس الاستجابة بعد الإصلاح.

- الجانب السلبي هو زيادة زمن التنفيذ بنسبة تتراوح بين 20% و50%.

الأهداف المستقبلية

يسعى Thinking Machines من خلال هذا البحث إلى فتح الطريق أمام استخدامات أكثر موثوقية للذكاء الاصطناعي.

- تمكين المؤسسات من الحصول على استجابات قابلة للتكرار لتعزيز الثقة.

- تحسين عمليات التعلم المعزز عبر تقليل الضوضاء الناتجة عن عدم الاتساق.

- نشر الكود والنتائج في سلسلة مدونة Connectionism لتشجيع التعاون والشفافية.

- توجيه هذه الأساليب نحو منتجات مستقبلية تدعم الباحثين والشركات الناشئة.

خطوة Thinking Machines Lab نحو جعل استجابات الذكاء الاصطناعي أكثر اتّساقًا تمثل تقدماً نوعياً، خصوصًا في المجالات التي تتطلب نتائج دقيقة وموثوقة مثل البحث العلمي والتطبيقات المؤسسية.