OpenAI تطلق gpt-oss-safeguard لنماذج السلامة مفتوحة المصدر

كشفت OpenAI عن gpt-oss-safeguard، أول مجموعة نماذج سلامة مفتوحة المصدر، تتيح للمطورين تطبيق سياساتهم الخاصة ومراجعة كيفية تفسير الذكاء الاصطناعي للقرارات عند تصنيف المحتوى الضار.

تفاصيل الخبر

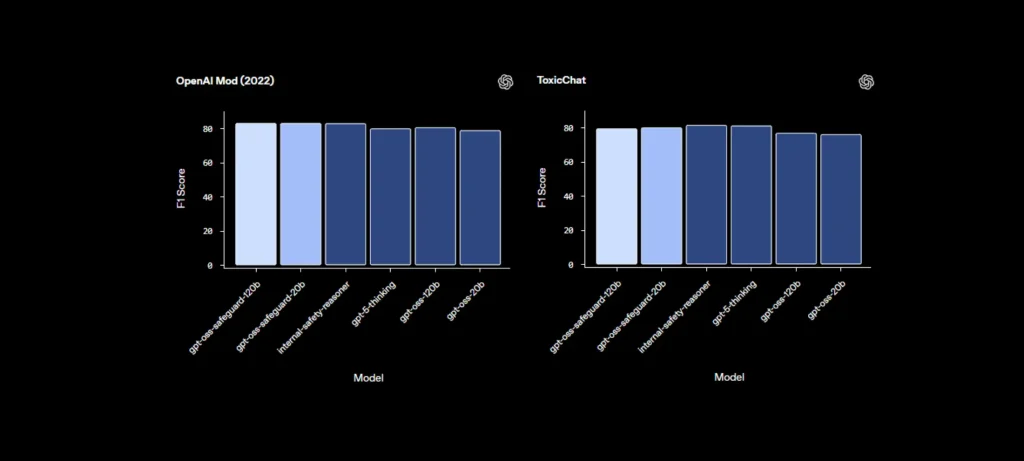

أعلنت OpenAI عن إطلاق gpt-oss-safeguard، نماذج مفتوحة المصدر متخصصة في تصنيف السلامة، متوفرة بحجمي 120B و20B، مع ترخيص Apache 2.0 يسمح بالتعديل والاستخدام بحرية.

أهم مميزات هذه النماذج:

- تصنيف المحتوى وفق سياسة محددة من المطور مباشرة أثناء الاستدلال، بدل الاعتماد على أمثلة مسبقة.

- تفسير القرار عبر chain-of-thought، ما يتيح فهم كيفية وصول النموذج إلى حكمه.

- مرونة عالية لتحديث السياسات بشكل سريع بدون الحاجة لإعادة تدريب النموذج.

- يمكن استخدامها لتصنيف الرسائل، المكملات، أو المحادثات الكاملة بحسب سياسات متنوعة.

- تدعم حالات معقدة حيث يكون الضرر متغيرًا أو دقيقًا للغاية.

تستهدف OpenAI عبر هذا الإصدار تمكين المطورين من تحديد السياسات التي تناسب تطبيقاتهم، مثل تصنيف المنشورات في منتديات الألعاب أو مراجعات المنتجات للتحقق من صحتها.

الأهداف المستقبلية

تهدف OpenAI من إطلاق gpt-oss-safeguard إلى:

- تمكين المجتمع البحثي والمطورين من دراسة واستخدام أدوات سلامة الذكاء الاصطناعي بحرية.

- تحسين الأداء في البيئات التي تتطلب تفسيرًا وشفافية عالية في القرارات.

- دعم التعاون مع شركاء مثل ROOST لإنشاء مجتمع نماذج مفتوح لمشاركة أفضل الممارسات وتحسين أدوات السلامة.

gpt-oss-safeguard يمثل خطوة مهمة نحو تعزيز الشفافية والمرونة في أدوات سلامة الذكاء الاصطناعي، ما يمكّن المطورين من تطبيق سياساتهم الخاصة بأمان وفعالية.