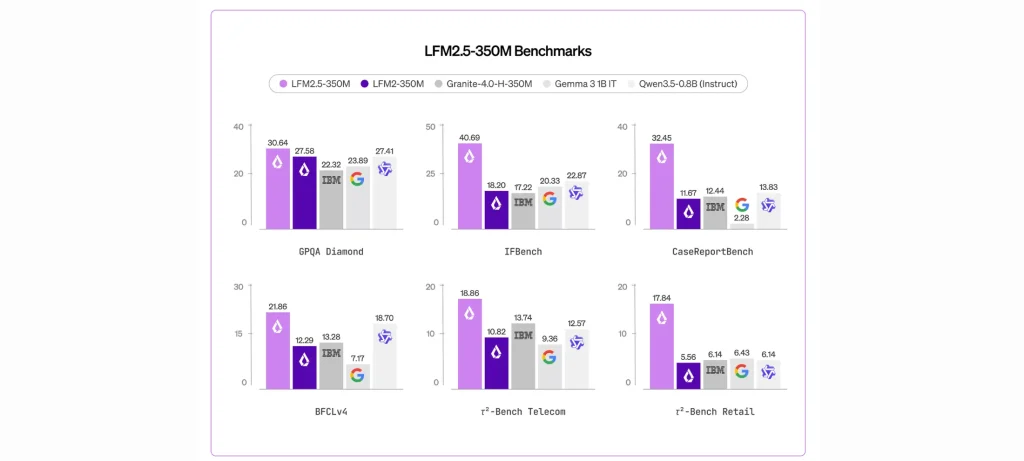

Liquid AI تطلق LFM2.5-350M نموذج صغير يتفوق على الكبار

في خطوة مهمة نحو مستقبل الذكاء الاصطناعي الخفيف، أعلنت Liquid AI عن إطلاق نموذج LFM2.5-350M، الذي يقدم أداءً قوياً رغم حجمه الصغير، مع قدرة على العمل بكفاءة على الأجهزة اليومية.

تفاصيل نموذج LFM2.5-350M الجديد

يمثل هذا النموذج تحولاً في فلسفة تطوير الذكاء الاصطناعي، حيث لم يعد الحجم الكبير هو العامل الحاسم في الأداء.

- يعتمد على 350 مليون معلمة فقط، لكنه يتفوق على نماذج أكبر منه بمرتين

- تم تدريبه على بيانات ضخمة تصل إلى 28 تريليون رمز (Token)

- يحقق أداءً مميزاً في استخدام الأدوات (Tool Use) واستخراج البيانات

- مصمم خصيصاً لتشغيل التطبيقات على الأجهزة الطرفية (Edge Devices)

- يوفر سرعة استدلال عالية جداً حتى على المعالجات الضعيفة (CPU)

- يدعم العمل على مجموعة واسعة من الأجهزة مثل الهواتف، الحواسيب، وإنترنت الأشياء

- يتكامل مع منصات متعددة مثل llama.cpp وMLX وvLLM

- مناسب لبناء وكلاء ذكاء اصطناعي خفيفين يعملون محلياً دون الحاجة إلى السحابة

الأهداف المستقبلية لهذا النموذج

تعكس هذه الخطوة رؤية Liquid AI لجعل الذكاء الاصطناعي أكثر كفاءة وانتشاراً.

- تمكين تشغيل الذكاء الاصطناعي محلياً على الأجهزة دون الاعتماد على الخوادم

- تقليل التكاليف المرتبطة بالنماذج الضخمة والبنية التحتية السحابية

- تسريع انتشار تطبيقات الذكاء الاصطناعي في الحياة اليومية

- دعم تطوير وكلاء ذكيين يعملون في الوقت الحقيقي على الأجهزة

- تحسين استهلاك الطاقة والموارد في تطبيقات الذكاء الاصطناعي

- فتح المجال أمام المطورين لبناء حلول مخصصة وخفيفة الوزن

في النهاية، يثبت هذا النموذج من Liquid AI أن مستقبل الذكاء الاصطناعي لا يعتمد فقط على الحجم، بل على الكفاءة والقدرة على العمل في أي مكان، مما يمهد لانتشار أوسع للتقنيات الذكية في حياتنا اليومية.