Liquid AI تطلق نموذج صغير قوي للاستخدام المحلي على الأجهزة

أعلنت شركة Liquid AI عن إطلاق النموذج التجريبي LFM2-2.6B-Exp، وهو نموذج ذكاء اصطناعي صغير الحجم مخصص للعمل على الأجهزة، مع أداء لافت في الرياضيات واتباع التعليمات.

تفاصيل الإعلان

كشفت Liquid AI عن نموذجها الجديد LFM2-2.6B-Exp، وهو إصدار تجريبي مبني على LFM2-2.6B باستخدام التعلم المعزز فقط، دون الاعتماد على بيانات بشرية مباشرة في هذه المرحلة. ويأتي النموذج ضمن توجه متزايد نحو تطوير نماذج صغيرة قادرة على العمل محلياً على الأجهزة مع الحفاظ على أداء قوي.

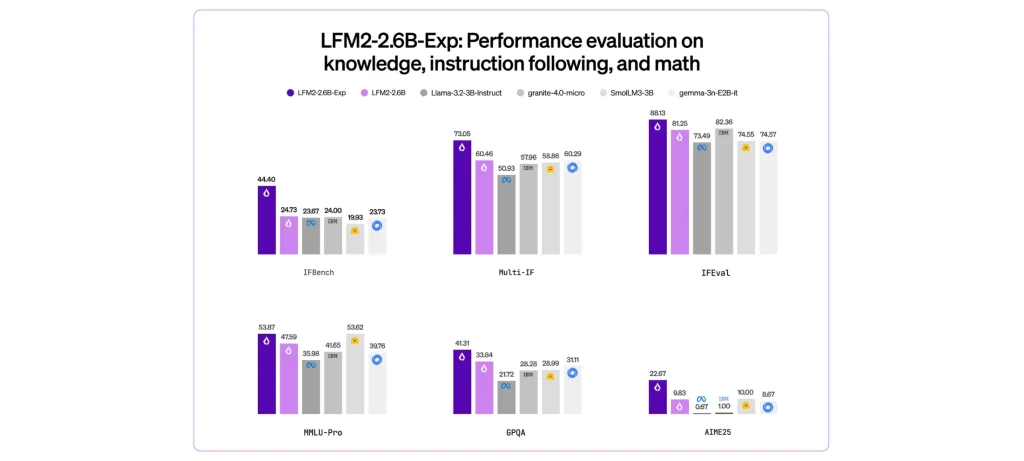

تم تدريب النموذج بشكل خاص على مهام اتباع التعليمات، والمعرفة العامة، والرياضيات، وحقق نتائج مميزة مقارنة بنماذج أخرى من نفس الفئة الحجمية. اللافت أن أداءه على مقياس IFBench تجاوز نموذج DeepSeek R1-0528، رغم أن الأخير أكبر منه بـ 263 مرة من حيث عدد المعلمات.

أبرز خصائص LFM2-2.6B-Exp:

- حجم صغير (2.6 مليار معلمة) مناسب للتشغيل على الجهاز.

- أداء قوي في الرياضيات واتباع التعليمات والمعرفة العامة.

- تفوق على نماذج أكبر بكثير في بعض معايير التقييم.

- سياق طويل يصل إلى 32,768 رمزاً.

- دعم عدة لغات، منها الإنجليزية والعربية والصينية والفرنسية والألمانية.

- بنية هجينة تجمع بين الالتفافات القصيرة والانتباه (GQA).

وتوصي Liquid AI باستخدام هذه النماذج بعد إجراء Fine-tuning لمهام محددة، مثل الوكلاء الذكيين، واستخراج البيانات، وRAG، والمحادثات متعددة الجولات، مع التحذير من استخدامها في المهام البرمجية المعقدة أو كثيفة المعرفة دون تخصيص إضافي.

الأهداف المستقبلية

يعكس هذا الإصدار رؤية Liquid AI في دفع حدود النماذج الصغيرة عالية الكفاءة، ومن أبرز الأهداف المستقبلية:

- تمكين تشغيل نماذج قوية مباشرة على الأجهزة الطرفية.

- تقليل الاعتماد على البنية السحابية المكلفة.

- دعم سيناريوهات الوكلاء الذكيين والتطبيقات المحلية.

- توسيع استخدام التعلم المعزز لتحسين الأداء دون بيانات بشرية.

يؤكد إطلاق LFM2-2.6B-Exp أن النماذج الصغيرة لم تعد بالضرورة محدودة القدرات، بل يمكنها منافسة نماذج أضخم، وفتح آفاق جديدة لتطبيقات الذكاء الاصطناعي على الأجهزة.