Liquid AI تطلق نموذج تفكير يعمل على الهواتف الذكية

كشفت شركة Liquid AI عن نموذج جديد باسم LFM2.5-1.2B-Thinking، يقدم قدرات استدلال متقدمة ضمن حجم صغير يسمح بتشغيله مباشرة على الهواتف الذكية والأجهزة الطرفية، مع أداء ينافس نماذج أكبر بكثير في الرياضيات وحل المشكلات.

تفاصيل الخبر

ينتمي LFM2.5 من Liquid AI إلى عائلة جديدة من النماذج الهجينة المصممة خصيصاً للتشغيل المحلي (On-device)، مع تركيز واضح على السرعة والكفاءة.

- يعتمد نموذج LFM2.5-1.2B-Thinking على 1.17 مليار معلمة فقط، مع بنية مكونة من 16 طبقة.

- تم تدريبه على 28 تريليون رمز، مقارنة بـ10 تريليونات في الجيل السابق.

- يدعم طول سياق يصل إلى 32,768 رمزاً، وهو رقم مرتفع لنموذج بحجمه.

- يعمل بأقل من 1 جيجابايت من الذاكرة، مع دعم فوري لأطر مثل llama.cpp وvLLM وMLX.

- يحقق سرعات استدلال عالية، تصل إلى 239 رمزاً في الثانية على معالجات AMD، و82 رمزاً في الثانية على وحدات NPU المحمولة.

- يدعم عدة لغات، من بينها العربية، الإنجليزية، الصينية، الفرنسية، اليابانية، والكورية.

- صُمم للاستخدام في المهام الوكيلة (Agentic tasks)، واستخراج البيانات، وRAG، مع عدم التوصية به للبرمجة أو المهام المعرفية الثقيلة.

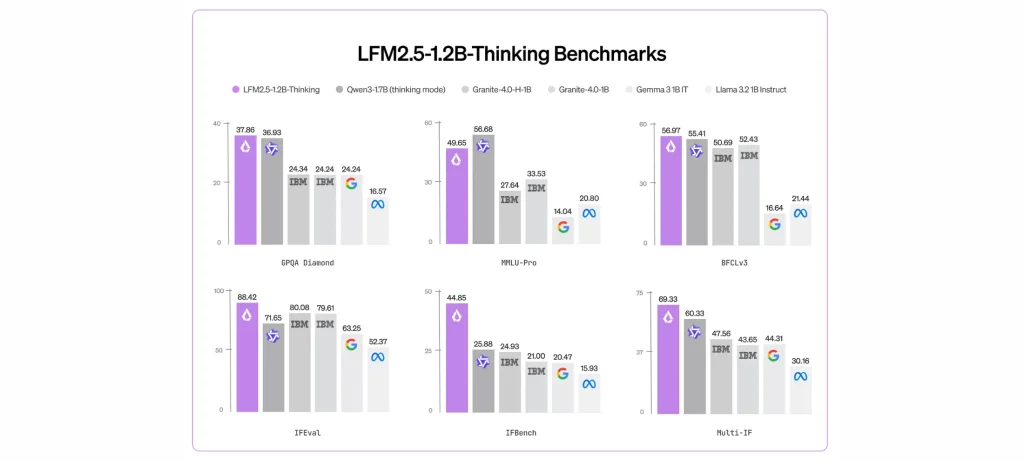

- أظهرت الاختبارات تفوقه أو مضاهاة أدائه لنماذج أكبر مثل Qwen وGemma في عدة معايير استدلالية.

الأهداف المستقبلية

تعكس هذه الخطوة رؤية Liquid AI لتوسيع نطاق الذكاء الاصطناعي خارج السحابة إلى الأجهزة اليومية.

- تمكين تشغيل نماذج استدلال قوية مباشرة على الهواتف دون اتصال دائم بالإنترنت.

- تقليل الاعتماد على البنية السحابية وخفض التكاليف.

- فتح المجال لاستخدامات جديدة في السيارات، وإنترنت الأشياء، والأجهزة القابلة للارتداء.

- تحسين الخصوصية عبر معالجة البيانات محلياً.

- تعزيز انتشار الذكاء الاصطناعي المتقدم في البيئات محدودة الموارد.

إطلاق LFM2.5-1.2B-Thinking يؤكد أن سباق الذكاء الاصطناعي لم يعد مقتصراً على النماذج العملاقة، بل يتجه بقوة نحو نماذج صغيرة وذكية قادرة على تقديم تفكير متقدم من داخل جيب المستخدم.