DeepSeek تكشف عن بنية نموذج جديدة لتعزيز الكفاءة والاستقرار

نشرت DeepSeek بحثًا جديدًا يقترح تغييرات في بنية الشبكات العصبية لتعزيز الاستقرار وتحسين أداء النماذج الكبيرة مع تكلفة حوسبة منخفضة، ما يمهّد لإطلاقات أكثر كفاءة قريبًا.

تفاصيل الخبر

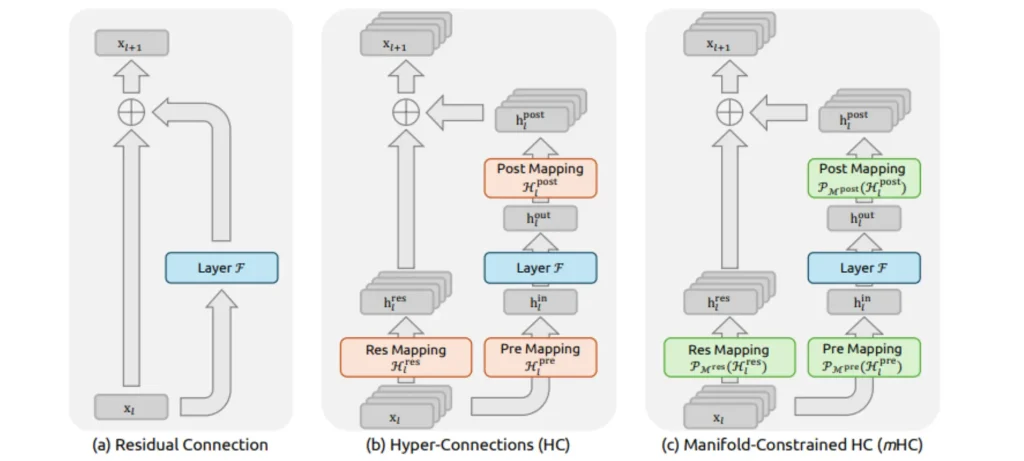

قدّم البحث الجديد تقنية mHC التي تعمل على تثبيت وتحسين تدريب الذكاء الاصطناعي على نطاق واسع مع إضافة تكلفة حوسبة ضئيلة.

- شارك الرئيس التنفيذي ليانغ وينفنغ في تأليف الورقة وتحميلها شخصيًا على arXiv، مؤكدًا التزامه العملي بالبحث.

- أظهرت الاختبارات على نماذج بوسائط 3B و9B و27B تحسينًا في نتائج المعايير، خصوصًا في مهام الاستدلال.

- البحث يتماشى مع الدراسات السابقة التي سبقت إطلاقات DeepSeek السابقة مثل R1 وV3، موحيًا بالتحسينات المستقبلية في الكفاءة.

- هذا يسلط الضوء على قدرة DeepSeek على تقديم نماذج متقدمة بأسعار أقل، مستفيدين من الوصول المتزايد إلى شرائح AI عالية الأداء.

الأهداف المستقبلية

تسعى DeepSeek إلى تعزيز تنافسيتها عبر تقنيات جديدة لتحسين الأداء وتقليل التكلفة، ما يجعل إصداراتها القادمة أكثر كفاءة وتأثيرًا.

- تحسين استقرار وكفاءة التدريب على نماذج كبيرة.

- خفض تكلفة التشغيل دون التضحية بالأداء.

- تعزيز قدرة الشركة على المنافسة في سوق النماذج المتقدمة عالميًا.

- مواصلة الابتكار في بنية الشبكات العصبية لدفع حدود الأداء والكفاءة.

ورقة DeepSeek الجديدة تشير إلى أن الشركة مستمرة في البحث عن طرق لتحسين الأداء وتقليل التكاليف، مما يجعل إصداراتها القادمة منافسًا قويًا في سوق الذكاء الاصطناعي العالمي.