BitNet b1.58: نموذج مايكروسوفت الثوري بترميز 1.58 بت

النموذج الجديد BitNet b1.58 من Microsoft Research يقدم ثورة في كفاءة الذكاء الاصطناعي بفضل ترميز ثلاثي القيم وأداء عالٍ على وحدات المعالجة المركزية.

تفاصيل الخبر

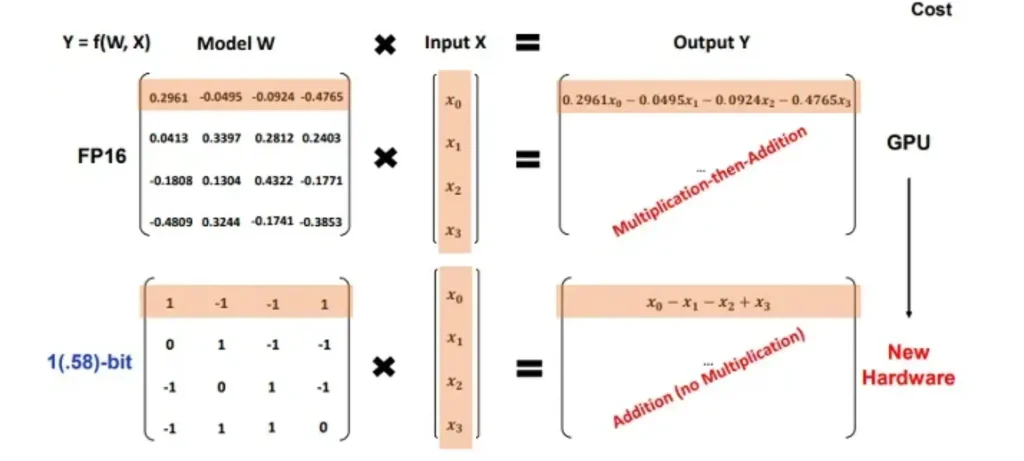

أعلنت Microsoft Research عن إطلاق نموذج BitNet b1.58 2B4T، وهو أول نموذج لغة كبير (LLM) بترميز ثلاثي القيم {−1, 0, 1}، يعمل بدقة 1.58 بت لكل وزن، ويضم 2 مليار معلمة. النموذج يقدّم أداءً يقارب النماذج كاملة الدقة، ولكن بكفاءة أعلى واستهلاك طاقة أقل.

أهم ما يميز BitNet b1.58:

- يعتمد على مكتبة مفتوحة المصدر bitnet.cpp، والتي تمكّن من تشغيل النموذج على المعالجات المركزية (CPU) بكفاءة عالية.

- يحقق تسريعًا يصل إلى 6.17× على معالجات x86 و5.07× على ARM.

- يقلل استهلاك الطاقة بنسبة تتراوح بين 55% إلى 82% حسب نوع المعالج.

- يتفوق أحيانًا على نماذج شهيرة مثل Llama 3.2 1B وGemma 3 1B وQwen 2.5 1.5B في اختبارات مثل GSM8K وPIQA.

- يتوفر على Hugging Face بصيغ متعددة، منها: packed 1.58-bit، BF16، GGUF.

- يمكن تشغيله محليًا حتى على أجهزة مثل Apple M2 بسرعات تقارب سرعة القراءة البشرية (5–7 رموز/ثانية).

الأهداف المستقبلية

تهدف مايكروسوفت من خلال هذا النموذج إلى:

- تمكين تشغيل LLMs محليًا على الأجهزة الشخصية والخوادم منخفضة المواصفات.

- نشر الذكاء الاصطناعي على الحافة (Edge AI) بدون الحاجة لسيرفرات سحابية ضخمة.

- فتح الباب أمام تصميم معالجات وذاكرات جديدة متخصصة في النماذج ذات الترميز المنخفض.

- دعم المطورين والباحثين من خلال إتاحة الكود والموديل برخصة مفتوحة (MIT) لتسريع الابتكار في هذا المجال.

BitNet b1.58 يُظهر كيف يمكن للذكاء الاصطناعي أن يصبح أكثر كفاءة، وخفة، وتوفرًا للجميع. إنه خطوة مهمة نحو مستقبل AI يعمل بسلاسة على كل جهاز.