Attention Residuals: تقنية Moonshot AI لتعزيز كفاءة الحوسبة

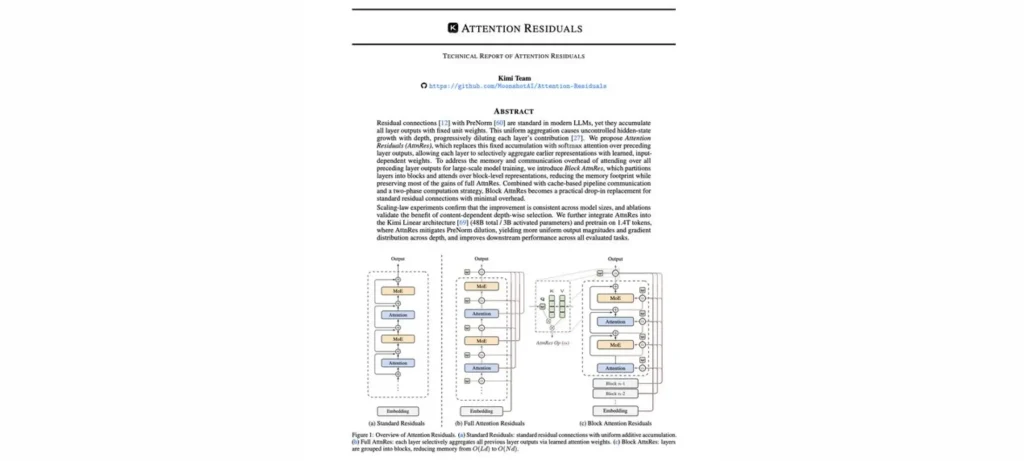

أعلنت شركة Moonshot AI عن تقنية جديدة باسم Attention Residuals، تهدف لتحسين كفاءة نماذج الذكاء الاصطناعي من خلال استدعاء الطبقات السابقة بدلًا من تكديسها بشكل تقليدي، ما يزيد الكفاءة الحاسوبية بنسبة 1.25×.

تفاصيل الخبر

قدمت Moonshot AI طريقة مبتكرة لإدارة المعلومات في الشبكات العصبية العميقة، تُعرف باسم Attention Residuals.

- تعتمد على انتباه ذكي لاستدعاء التمثيلات من الطبقات السابقة بدلًا من الاعتماد على تراكم ثابت.

- تُقسم الطبقات إلى كتل مضغوطة عبر Block AttnRes، ما يجعل الانتباه عبر الطبقات عمليًا حتى على النماذج الكبيرة.

- يمكن استخدامها كبديل مباشر للوصلات التقليدية، مع زيادة كفاءة الحوسبة بنسبة 1.25× وتأخير منخفض جدًا (<2%).

- تم اختبارها على بنية Kimi Linear (48B إجمالي، 3B معلمات مفعلة) مع نتائج أداء محسنة بشكل ثابت.

- تساعد التقنية في الحد من نمو الحالات المخفية وتوزيع التدرجات بشكل أكثر اتساقًا عبر العمق.

الأهداف المستقبلية

تهدف هذه التقنية إلى رفع كفاءة الشبكات العصبية العميقة مع الحفاظ على دقة الأداء وتسهيل التوسع على نماذج أكبر.

- تمكين النماذج من استدعاء المعلومات السابقة بشكل انتقائي وذكي.

- تقليل استهلاك الموارد الحاسوبية دون التضحية بالدقة.

- دعم النماذج الضخمة عبر تحسين توزيع التدرجات وتقليل التضاؤل الداخلي للمعلومات.

- تسريع التدريب والتحسين على نطاق واسع.

- جعل الانتباه عبر الطبقات أسهل للتطبيق على النماذج الحديثة والمتقدمة.

تفتح تقنية Attention Residuals أفقًا جديدًا لتحسين كفاءة نماذج الذكاء الاصطناعي، مما يجعل الشبكات العصبية العميقة أسرع وأكثر قدرة على التعامل مع المهام الكبيرة والمعقدة.