باحثة في OpenAI تستقيل وتحذر من مخاطر إعلانات ChatGPT

أعلنت الباحثة السابقة في OpenAI Zoë Hitzig استقالتها من الشركة في مقال رأي، معربة عن قلقها العميق من التداعيات الأخلاقية لاستراتيجية إدخال الإعلانات في ChatGPT، محذرة من أن أرشيف المستخدمين قد يُستخدَم بأساليب لا يمكن فهمها أو منعها.

تفاصيل الاستقالة والتحذير

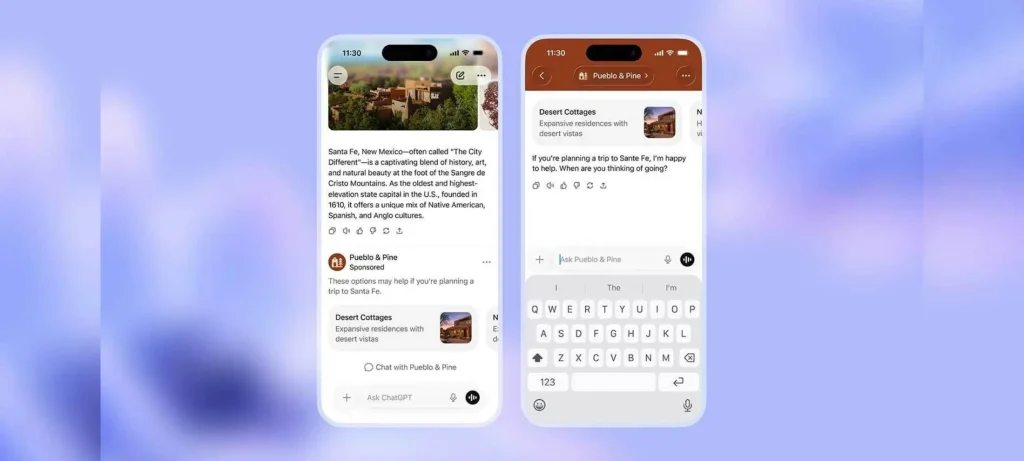

في مقاله، أوضحت Hitzig أنها غادرت الشركة في نفس اليوم الذي بدأت فيه OpenAI اختبار الإعلانات داخل ChatGPT، قائلة إنها فقدت الثقة في قدرة الشركة على الاستمرار في الالتزام بالقيم التي انضمت إليها من أجلها.

- قالت إن ChatGPT قد جمع أرشيفًا غير مسبوق من الاعترافات الشخصية — مثل المخاوف الصحية، المشكلات العاطفية، والمعتقدات الدينية — حيث شارك المستخدمون هذه المعلومات معتقدين أنهم يتحدثون إلى نظام محايد بلا أجندات خفية.

- ربطت بين قرار OpenAI بالسير في طريق الإعلانات والنموذج الأول الذي اتبعه Meta (Facebook)، الذي وعد بحماية خصوصية البيانات قبل أن تتآكل تلك الوعود مع مرور الوقت.

- حذرت من أن الجمع بين قاعدة بيانات ضخمة من المعلومات الحساسة ونظام إعلاني قد يؤدي إلى سوء استخدام البيانات أو التلاعب بالمستخدمين بطرق لا نملك أدوات لفهمها أو منعها.

رغم أن Hitzig لا ترى الإعلانات بحدّ ذاتها “غير أخلاقية”، إلا أنها تشعر بأن الطريقة التي تُستخدم بها تلك البيانات الشخصية من شأنها أن تولد ضغوطًا مالية تجذب الشركة لتجاوز سياساتها الخاصة لحماية الخصوصية.

رؤية بديلة للمستقبل

بدلًا من الاعتماد على نموذج الإعلانات القائم على الاستخدام المكثف للبيانات، اقترحت Hitzig بدائل مثل:

- اعتماد نماذج تمويل تعاونية أو صناديق بيانات تمنح المستخدمين سيطرة أكبر على ما يتم مشاركته؛

- إنشاء هيئات رقابية مستقلة ملزمة قانونيًا على كيفية استخدام بيانات الدردشة في الإعلانات.

تحذيرها سلط الضوء على أحد الجوانب المثيرة للجدل في دمج الإعلانات داخل أدوات الذكاء الاصطناعي، وهو فقدان الثقة بشأن تأثير ذلك على خصوصية وسلوك المستخدمين.