Docker تعالج ثغرة في مساعد الذكاء الاصطناعي Ask Gordon

كشف باحثو الأمن السيبراني عن ثغرة أمنية خطيرة في مساعد الذكاء الاصطناعي (Ask Gordon) التابع لشركة “Docker“، تسمح للمهاجمين بتنفيذ تعليمات برمجية خبيثة وتسريب بيانات حساسة عبر التلاعب ببيانات الصور الوصفية.

تفاصيل ثغرة DockerDash وتأثيرها الأمني

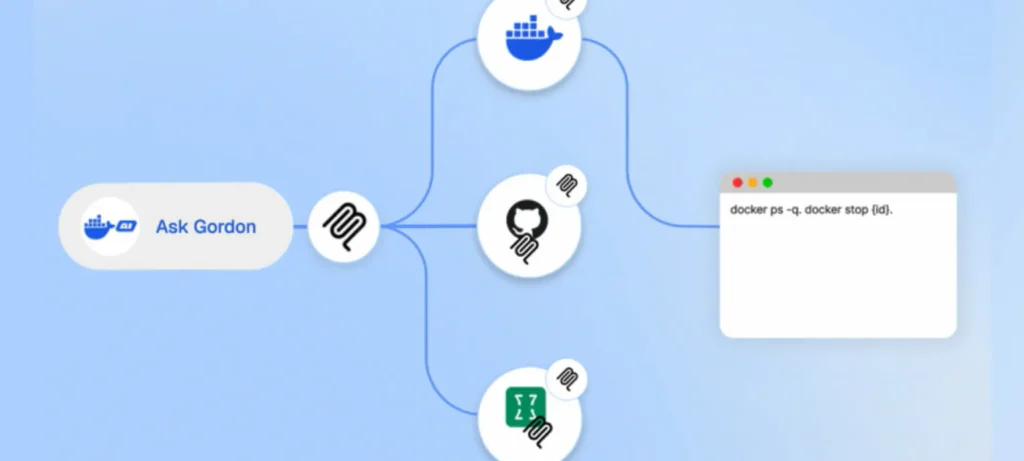

الثغرة التي أُطلق عليها اسم DockerDash وتم تصحيحها في الإصدار 4.50.0، تكمن في كيفية معالجة المساعد الذكي للبيانات الوصفية (Metadata) داخل صور “دوكر”. حيث يثق النظام بشكل أعمى في تعليمات مخفية داخل حقول LABEL في ملفات Dockerfile، مما يحولها من مجرد معلومات وصفية إلى أوامر تنفيذية تتجاوز الحواجز الأمنية.

سلسلة الهجوم المتبعة في هذه الثغرة:

- زرع الحمولة: يقوم المهاجم بنشر صورة دوكر تحتوي على تعليمات خبيثة داخل حقول “LABEL”.

- الخداع بالاستعلام: بمجرد أن يستفسر المستخدم عن الصورة، يقرأ المساعد الذكي هذه التعليمات كأوامر موثوقة.

- التمرير لبوابة MCP: يتم توجيه الأوامر إلى بوابة “Model Context Protocol” التي تفتقر لآليات التحقق.

- التنفيذ الكامل: تقوم أدوات MCP بتنفيذ الأوامر بصلاحيات المستخدم، مما يؤدي لاختراق النظام أو سحب البيانات.

الأهداف المستقبلية

تؤكد هذه الحادثة أن الثقة في المصادر المدخلة للذكاء الاصطناعي أصبحت ثغرة بحد ذاتها، وتخطط مجتمعات الأمن السيبراني للتركيز على الأهداف التالية مستقبلاً:

- تطبيق مبدأ “Zero Trust”: فرض التحقق من الصحة على جميع البيانات السياقية المقدمة لنماذج الذكاء الاصطناعي قبل معالجتها.

- تطوير بوابات MCP الذكية: بناء أنظمة وسيطة قادرة على التمييز بين البيانات الوصفية المعلوماتية والأوامر التنفيذية.

- تأمين سلاسل التوريد (AI Supply Chain): مراقبة وتدقيق الحمولات المخفية في مستودعات الصور العامة مثل Docker Hub.

- عزل الصلاحيات: تقييد قدرة المساعدات الذكية على الوصول إلى بيئة النظام المحلي دون تدخل بشري مباشر.

تُعد ثغرة DockerDash تذكيراً قوياً بأن دمج الذكاء الاصطناعي في أدوات المطورين يفتح أبواباً جديدة للتهديدات؛ لذا فإن التحديث الفوري للأنظمة يظل خط الدفاع الأول والأهم في مواجهة هذه الهجمات المتطورة.