إطلاق GLM-4.7-Flash نموذج 30B سريع ينافس الكبار

أعلنت Z AI عن إطلاق GLM-4.7-Flash، وهو نموذج مفتوح المصدر يركز على السرعة والكفاءة، ليقدّم أداءً متقدماً ضمن فئة 30 مليار معلمة، ويمنح المطورين خياراً عملياً للنشر الخفيف دون التضحية بالقوة.

تفاصيل الخبر

يأتي GLM-4.7-Flash كنموذج MoE بحجم 30B-A3B، ويُصنّف كأقوى نموذج في فئته من حيث التوازن بين الأداء والكفاءة، ما يجعله مناسباً لسيناريوهات الإنتاج والنشر المحلي.

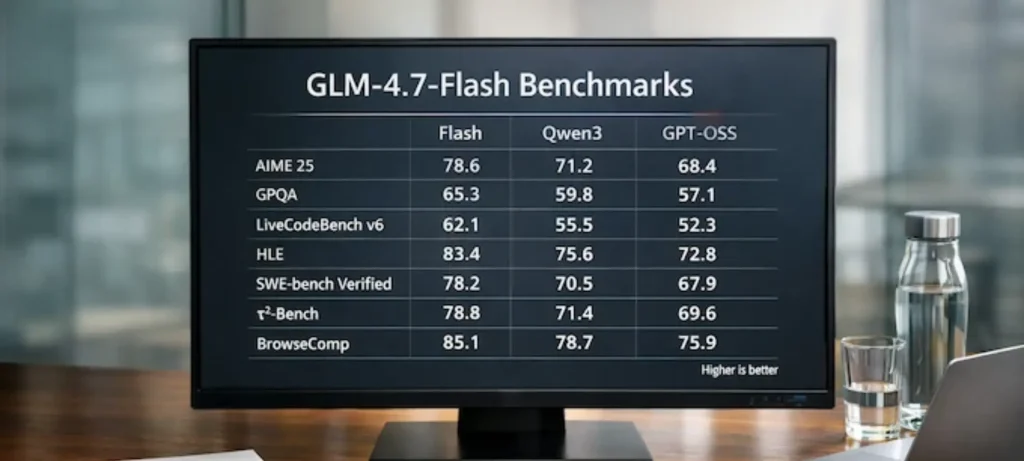

- حقق أداءً متقدماً في اختبارات AIME 25 بنتيجة 91.6، متقارباً مع نماذج أكبر حجماً.

- تفوق بوضوح في SWE-bench Verified مسجلاً 59.2، مقابل 22.0 و34.0 لمنافسين مباشرين.

- أظهر نتائج قوية في τ²-Bench وBrowseComp، ما يعكس كفاءته في المهام متعددة الخطوات والتصفح.

- يتيح إعدادات مرنة للتقييم تشمل سياقات طويلة تصل إلى 131 ألف توكن في الإعدادات الافتراضية.

- يدعم النشر المحلي عبر أطر vLLM وSGLang، مع تكامل مباشر مع Transformers من Hugging Face.

الأهداف المستقبلية

يعكس إطلاق GLM-4.7-Flash توجهاً واضحاً نحو نماذج أخف وأكثر كفاءة دون الاعتماد على أحجام ضخمة.

- تمكين الشركات من تشغيل نماذج قوية محلياً بتكلفة أقل.

- تسريع تبني الذكاء الاصطناعي المفتوح المصدر في البيئات الإنتاجية.

- تقليل الفجوة بين النماذج التجارية المغلقة والنماذج المفتوحة.

- دعم سيناريوهات الوكلاء الذكيين والمهام طويلة المدى بكفاءة أعلى.

- تعزيز المنافسة في فئة النماذج المتوسطة الحجم ذات الأداء العالي.

مع GLM-4.7-Flash، تؤكد Z AI أن الابتكار لا يرتبط دائماً بالحجم الأكبر، بل بالتصميم الذكي الذي يجمع بين السرعة، الكفاءة، وقوة الأداء، ما يجعله خياراً لافتاً في مشهد النماذج المفتوحة.