من Gemma 3 إلى FunctionGemma: نموذج Google الصغير

أعلنت Google عن FunctionGemma، وهو نموذج ذكاء اصطناعي مدمج ومتخصص في تنفيذ الأوامر البرمجية، مصمم للعمل بكفاءة على الأجهزة الطرفية مع استهلاك منخفض للموارد.

تفاصيل الخبر

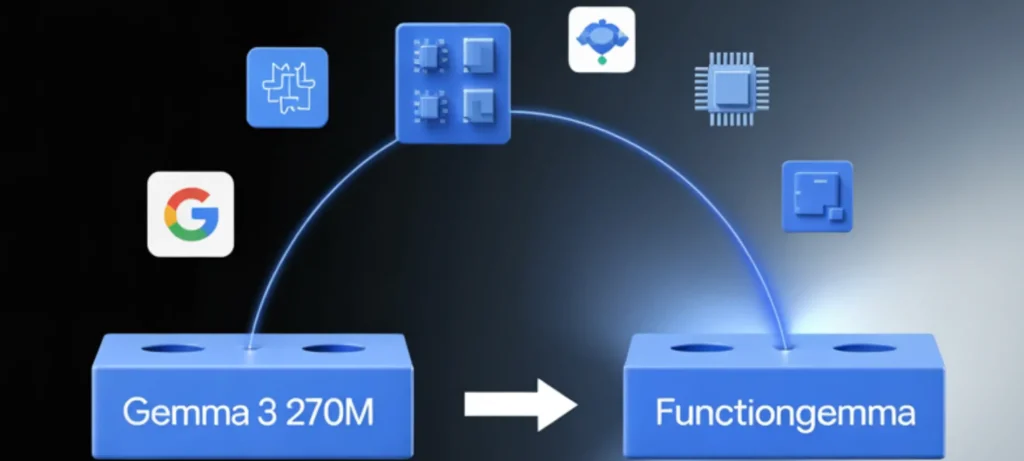

في خطوة تعكس توجه Google نحو النماذج الصغيرة عالية التخصص، كشفت الشركة عن FunctionGemma، وهو إصدار مبني على Gemma 3 بحجم 270 مليون معامل، لكنه لا يستهدف المحادثة العامة، بل يركز حصريًا على تحويل اللغة الطبيعية إلى أوامر ودوال قابلة للتنفيذ. يهدف النموذج إلى العمل كـ “وكيل ذكي” على الأجهزة الطرفية مثل الهواتف والحواسيب المحمولة دون الحاجة إلى اتصال دائم بالخوادم.

أبرز الجوانب التقنية والوظيفية في FunctionGemma تشمل:

- نموذج نصي فقط مبني على معمارية Gemma 3 وبحجم 270M معامل.

- مصمم خصيصًا لاستدعاء الدوال (Function Calling) وليس للدردشة المفتوحة.

- يستخدم مفردات كبيرة محسّنة لبُنى JSON والنصوص متعددة اللغات.

- يدعم سياقًا يصل إلى 32 ألف رمز مشترك بين الإدخال والإخراج.

- مدرّب على 6 تريليونات رمز بيانات مع تركيز على تعريفات الأدوات والتفاعل معها.

- يعتمد قالب محادثة صارم مع رموز تحكم تفصل بين الأوامر، التعريفات، والاستجابات.

- يترجم أوامر المستخدم إلى استدعاءات API دقيقة مع إمكانية تلخيص النتائج.

الأهداف المستقبلية

تسعى Google من خلال FunctionGemma إلى تمكين جيل جديد من الوكلاء الأذكياء العاملين محليًا، مع تقليل الاعتماد على البنية السحابية.

ومن أبرز الأهداف المتوقعة:

- دعم تطبيقات تعمل بالكامل دون اتصال بالإنترنت.

- تحسين أداء التحكم بالأجهزة والأنظمة عبر اللغة الطبيعية.

- تمكين المطورين من تخصيص النموذج لمهام محددة عبر Fine-tuning.

- توسيع استخدامه في الهواتف، الحواسيب، وأجهزة الحافة منخفضة الاستهلاك.

- تعزيز دقة استدعاء الدوال في البيئات الإنتاجية.

- بناء تجارب تفاعلية مثل الألعاب، التحكم الذكي، والمحاكاة داخل المتصفح.

يمثل FunctionGemma مثالًا واضحًا على أن مستقبل الذكاء الاصطناعي لا يعتمد فقط على النماذج الضخمة، بل على النماذج الصغيرة المتخصصة القادرة على العمل محليًا بكفاءة عالية، ما يفتح آفاقًا جديدة لتطبيقات ذكية أسرع وأكثر خصوصية.