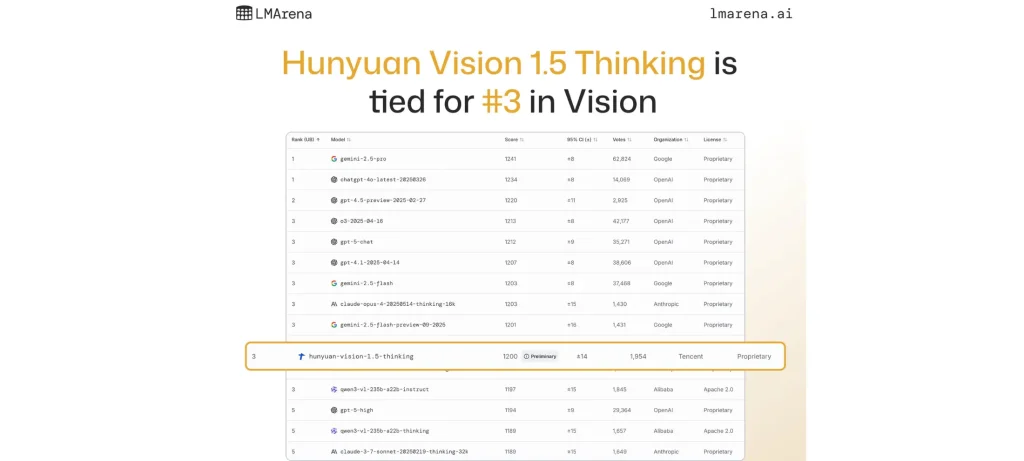

Tencent تطلق Hunyuan-Vision-1.5-Thinking

أعلنت Tencent عن إصدار Hunyuan-Vision-1.5-Thinking، نموذج رؤية-لغة متعدد الوسائط، والذي حقق المرتبة الثالثة على لائحة LM Arena، مع قدرات متقدمة في الفهم البصري والتفكير على الصور.

تفاصيل الخبر

كشف Tencent عن نموذج Hunyuan-Vision-1.5-Thinking، المبني على هندسة هجينة mamba-transformer، والذي يقدم أداءً متقدمًا في مهام الفهم متعدد الوسائط والتفكير البصري. النموذج يدعم مهام متعددة من التعرف على الصور والفيديوهات إلى التفكير البصري وفهم الأبعاد الثلاثية، مع تجربة مستخدم سلسة متعددة اللغات.

أبرز المميزات:

- هندسة هجينة مبتكرة: تضمن أداءً متفوقًا وكفاءة عالية في الاستنتاج متعدد الوسائط.

- تفكير على الصور (“Thinking-on-Image”): دعم فهم أعمق وتحليل بصري متقدم من خلال نموذج الانعكاس البصري الجديد.

- تعدد المهام والتطبيقات: يشمل التعرف على الصور والفيديو، تحليل المخططات، القراءة الضوئية (OCR)، والفهم المكاني ثلاثي الأبعاد.

- تجربة متعددة اللغات: أداء سلس عبر مختلف اللغات وسياقات المهام المتنوعة.

- إمكانية الوصول المفتوح: النموذج والتقرير الفني سيتم إصدارهما مفتوح المصدر أواخر أكتوبر، مع توفره حالياً عبر Tencent Cloud.

الأهداف المستقبلية

يهدف Hunyuan-Vision-1.5-Thinking إلى توسيع آفاق الفهم متعدد الوسائط وإعادة تعريف الذكاء البصري:

- تعزيز قدرات التفكير البصري المتقدم مع دعم أدوات إضافية لتحليل الصور (قص، تكبير، رسم نقاط وخطوط).

- توسيع دعم اللغات المتعددة لتوفير تجربة مستخدم عالمية.

- تطوير فهم ثلاثي الأبعاد ومعقد للصور والفيديوهات في التطبيقات الواقعية.

- دمج أدوات البحث والمعرفة عبر الويب لدعم استنتاج أعمق وأكثر دقة.

- تمكين المطورين والباحثين من تجربة النموذج مباشرة على Tencent Cloud وLMArena Direct Chat.

يمثل Hunyuan-Vision-1.5-Thinking خطوة مهمة نحو الذكاء البصري متعدد الوسائط، مع دمج التفكير البصري العميق والفهم متعدد اللغات. النموذج يضع Tencent في مقدمة المنافسة العالمية في هذا المجال.