Scale AI تطلق SEAL Showdown لتقييم أداء نماذج الذكاء الصناعي

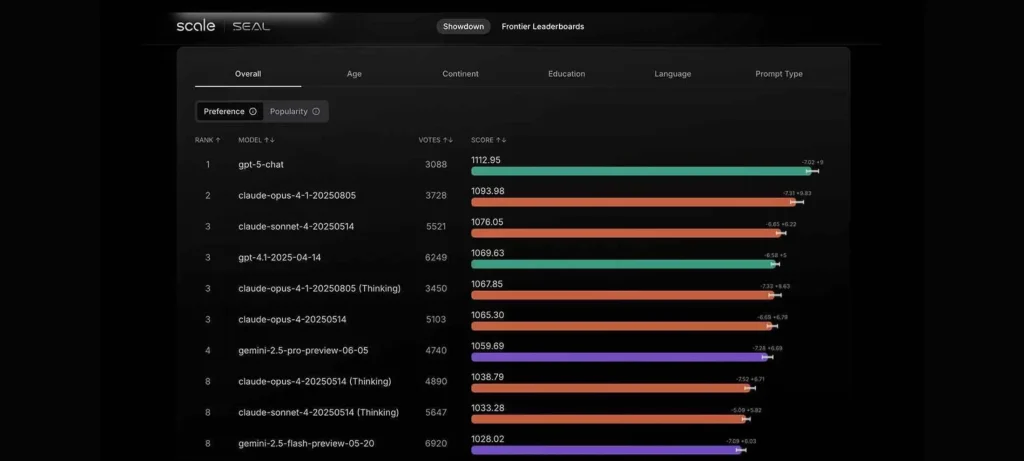

أعلنت Scale AI عن إطلاق منصة SEAL Showdown الجديدة، التي تقيس أداء النماذج اللغوية الكبيرة (LLMs) وفق تفضيلات المستخدمين الحقيقية عبر فئات ديموغرافية مختلفة.

تفاصيل الخبر

تقدم SEAL Showdown طريقة مبتكرة لتقييم النماذج مقارنة بمنصات مثل LMArena، من خلال الاستفادة من شبكة المساهمين العالمية الخاصة بـ Scale AI:

- تغطي الشبكة أكثر من 100 دولة و70 لغة، حيث يشارك المستخدمون في التصويت الاختياري لتحديد تفضيلاتهم.

- يمكن للمساهمين تجربة النماذج المتقدمة مجاناً عبر تطبيق Playground وإجراء مقارنات مباشرة بين النماذج لجمع بيانات تفضيلات حقيقية.

- تحظر المنصة مشاركة البيانات لمدة 60 يومًا بعد جمعها، لضمان نزاهة النتائج ومنع التلاعب.

- لوحات الترتيب مقسمة حسب العمر، التعليم، واللغة لتقديم رؤية دقيقة لأداء النماذج عبر المجموعات المختلفة.

- توفر SEAL Showdown بيانات مفصلة تساعد في تحديد النماذج الأفضل لمهام محددة وفئات متنوعة من المستخدمين.

الأهداف المستقبلية

تهدف Scale AI من إطلاق SEAL Showdown إلى:

- تقديم تقييمات أكثر دقة وواقعية لأداء النماذج اللغوية الكبيرة.

- توسيع المنافسة في مجال منصات الترتيب وتحليل أداء النماذج.

- تمكين الباحثين والمطورين من اختيار النموذج الأنسب لكل فئة ديموغرافية أو مهمة محددة.

- تعزيز الشفافية والاعتماد على تفضيلات المستخدمين الحقيقية في تقييم الذكاء الاصطناعي.

منصة SEAL Showdown تعكس خطوة مهمة من Scale AI نحو تحسين تقييم النماذج الذكية، مع التركيز على احتياجات المستخدمين الحقيقية وتوفير بيانات دقيقة لصانعي القرار في عالم الذكاء الاصطناعي.