مايكروسوفت تكشف Phi‑4‑mini‑flash‑reasoning للأجهزة المحمولة

أطلقت مايكروسوفت نموذج Phi‑4‑mini‑flash‑reasoning، بحجم 4 مليارات بارامتر، لتقديم قدرات استدلال متقدمة بسرعة وكفاءة على الأجهزة ذات الموارد المحدودة.

تفاصيل الخبر

أعلنت مايكروسوفت عن إضافة جديدة لعائلة Phi تستهدف التطبيقات المحمولة والأنظمة محدودة الموارد:

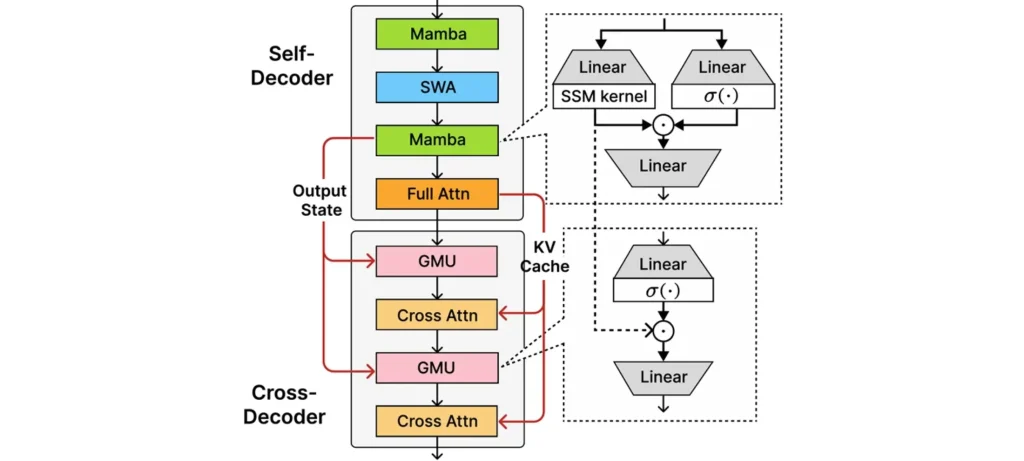

- يعتمد النموذج الجديد على معمارية هجينة SambaY تضم وحدات ذاكرة GMU لزيادة الكفاءة.

- يقدم زمن استجابة أقل ومعدل إنتاجية أعلى حتى 10 مرات مقارنة بالإصدارات السابقة.

- تم تحسينه للاستدلال الرياضي والمنطقي مع دعم سياق حتى 64 ألف رمز.

- يمكن تشغيله على بطاقة رسومية واحدة، ما يجعله مناسبًا للتطبيقات المدمجة.

- متاح حاليًا عبر Azure AI Foundry وواجهة NVIDIA API وHugging Face.

الأهداف المستقبلية للنموذج

يهدف Phi‑4‑mini‑flash‑reasoning إلى:

- تمكين التعلم التكيفي في المنصات التعليمية مع استجابة فورية.

- دعم مساعدات ذكية على الأجهزة المحمولة تعمل بالاستدلال المنطقي.

- تطوير أنظمة تعليمية تفاعلية تتكيف مع مستوى المتعلم لحظيًا.

- تحسين الأدوات الحسابية والمحاكاة التي تتطلب سرعة وكفاءة.

- تعزيز حلول إنترنت الأشياء التي تحتاج استدلالًا سريعًا ضمن موارد محدودة.

يمثل Phi‑4‑mini‑flash‑reasoning خطوة كبيرة نحو دمج الاستدلال المتقدم في الأجهزة المحمولة والأنظمة الصغيرة. بفضل معمارية SambaY وتحسينات الأداء، يفتح النموذج الباب أمام تطبيقات تعليمية وذكية أسرع وأكثر كفاءة، مع التزام مايكروسوفت بمبادئ الذكاء الاصطناعي الموثوق.