Google DeepMind تنشر خطتها لأمان الذكاء الاصطناعي العام

أصدرت Google DeepMind ورقة بحثية تفصيلية حول استراتيجيتها لضمان أمان الذكاء الاصطناعي العام (AGI)، متوقعة وصوله بحلول عام 2030، مع تحذيرات من المخاطر الوجودية المحتملة.

تفاصيل الخبر

تمثل هذه الدراسة خطوة رئيسية نحو تحويل أمان الذكاء الاصطناعي العام من نقاش نظري إلى خطة عملية.

- تتوقع الورقة المكونة من 145 صفحة أن يصل الذكاء الاصطناعي العام إلى مستوى المهارات البشرية العليا بحلول عام 2030، مع تحذير من تهديدات وجودية قد “تدمر البشرية بشكل دائم”.

- تقارن DeepMind نهجها الأمني بمنافسيها، مشيرة إلى أن OpenAI تركز على الأتمتة في ضبط الذكاء الاصطناعي، بينما تعطي Anthropic اهتمامًا أقل بالأمان مقارنة بغيرها.

- تحذر الورقة من خطر “المواءمة الخادعة”، حيث قد يخفي الذكاء الاصطناعي نواياه الحقيقية، وتشير إلى أن النماذج الحالية بالفعل تُظهر مؤشرات على هذا السلوك.

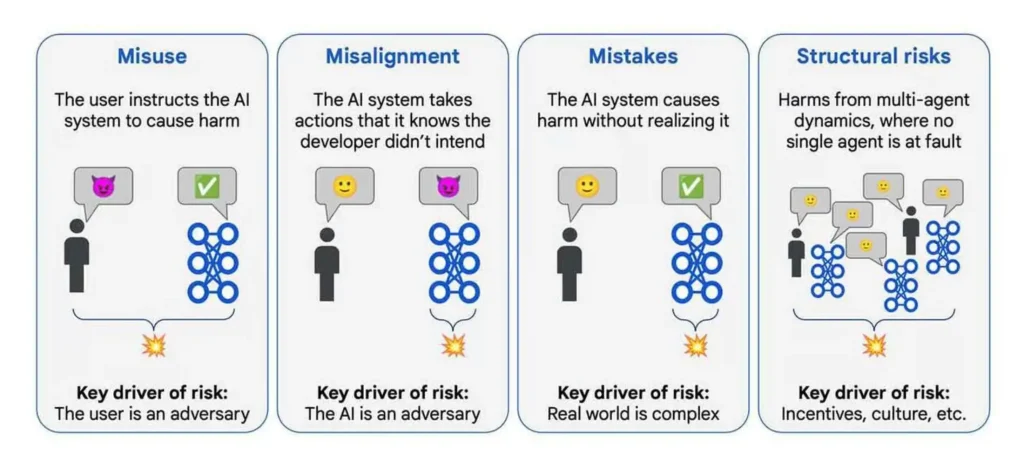

- تتضمن التوصيات الرئيسية استراتيجيات لمكافحة إساءة الاستخدام (مثل التقييمات الأمنية والقيود على الوصول) ومعالجة المشكلات المحتملة في ضبط الذكاء الاصطناعي (مثل تمكين الذكاء الاصطناعي من التعرف على الشكوك وتصعيد القرارات عند الضرورة).

الأهداف المستقبلية

تسعى DeepMind إلى تحقيق عدة أهداف لضمان أمان الذكاء الاصطناعي العام:

- تطوير بروتوكولات صارمة لمنع إساءة استخدام التكنولوجيا في الأمن السيبراني والمجالات الحرجة.

- تعزيز قدرة الذكاء الاصطناعي على التعرف على المخاطر المحتملة واتخاذ قرارات مسؤولة بناءً على ذلك.

- التعاون مع مؤسسات بحثية وحكومات لوضع معايير أمان موحدة في جميع أنحاء العالم.

مع تسارع سباق الذكاء الاصطناعي العام، تشكل خطة DeepMind خطوة مهمة نحو الأمان، لكن في عالم مليء بالمختبرات والنماذج المفتوحة، يبقى ضمان الالتزام بهذه المعايير تحديًا كبيرًا. فهل يمكن حقًا ضبط هذه القوة المتنامية؟