ميتا تطلق نظام Omnilingual ASR للتعرف على الكلام بـ1600 لغة

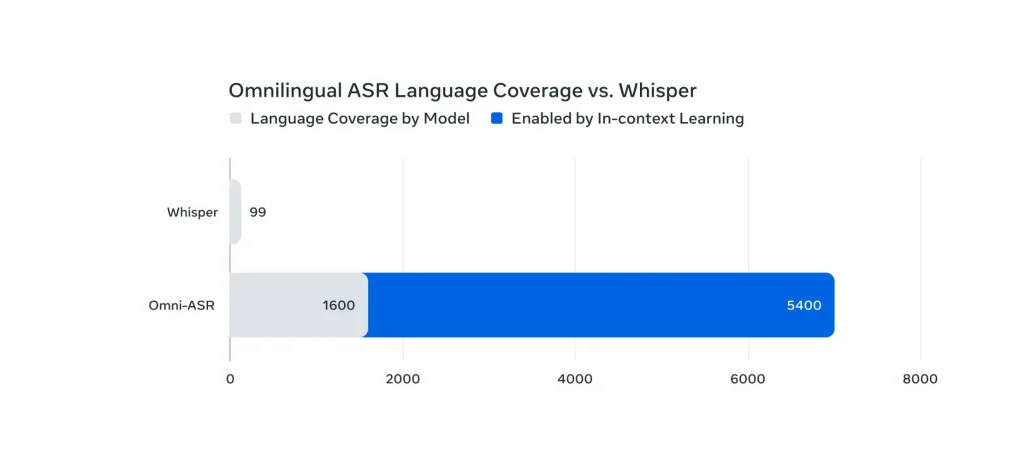

كشفت شركة “ميتا” عن نظامها الجديد أومني لينغوال إيه إس آر (Omnilingual ASR) الذي يمثل طفرة في مجال التعرف التلقائي على الكلام، إذ يدعم أكثر من 1600 لغة حول العالم، متفوقاً بذلك على نموذج “ويسبر” من “أوبن أيه آي” الذي يدعم 99 لغة فقط.

تفاصيل الخبر

قدّمت “ميتا” النظام من خلال فريق أبحاث الذكاء الاصطناعي الأساسي (FAIR) ليكون منصة مفتوحة المصدر بموجب ترخيص “أباتشي 2.0″، مما يسمح للباحثين والمطورين باستخدامه وتطويره بحرية.

- يعتمد نظام Omnilingual ASR على تقنيات التعلم الذاتي ويمتاز بقدرته على التوسع إلى آلاف اللغات الإضافية دون الحاجة لإعادة التدريب.

- يتيح النظام للمستخدمين تزويده بأمثلة صوتية ونصية بسيطة بلغة جديدة، ليتمكن من نسخ الكلام بها فوراً.

- يضم المشروع أيضاً قاعدة بيانات ضخمة تحتوي على مقاطع صوتية مكتوبة لأكثر من 350 لغة قليلة الموارد.

- تم تطوير النظام باستخدام نسخة مطوّرة من نموذج wav2vec 2.0 الذي تم توسيعه إلى 7 مليارات معامل لتمثيل الكلام بشكل متعدد اللغات.

- تقدم “ميتا” النظام في مجموعة نماذج مختلفة تناسب الأجهزة منخفضة الطاقة وكذلك الاستخدامات المتقدمة بدقة عالية.

- شاركت الشركة مع مؤسسات لغوية مثل Mozilla Common Voice وLanfrica/NaijaVoices لدعم المجتمعات اللغوية المحلية.

الأهداف المستقبلية

تهدف “ميتا” من خلال مشروع Omnilingual ASR إلى جعل تكنولوجيا التعرف على الكلام متاحة لجميع لغات العالم وتقليص الفجوة الرقمية بين اللغات الشائعة وتلك غير الممثلة رقمياً.

- تمكين المتحدثين باللغات النادرة من الاستفادة من تقنيات الذكاء الاصطناعي.

- تحقيق تغطية عالمية شاملة لأكثر من 5400 لغة منطوقة.

- دعم الأبحاث والمشاريع المجتمعية عبر فتح المصدر وإتاحة البيانات للباحثين.

- تعزيز التواصل بين الثقافات وكسر الحواجز اللغوية من خلال أدوات ذكاء اصطناعي مرنة وقابلة للتطوير.

يمثل نظام Omnilingual ASR خطوة نوعية نحو بناء جسر رقمي يربط اللغات والثقافات، ويجعل الصوت أداة عالمية للتواصل والفهم بين الشعوب، مما يعزز هدف ميتا في تقريب العالم من بعضه أكثر من أي وقت مضى.