تقنية TurboQuant من Google تقلل ذاكرة الذكاء الاصطناعي

يشهد مجال الذكاء الاصطناعي تطورًا تقنيًا جديدًا مع إعلان Google عن خوارزمية TurboQuant، التي تقلل استهلاك الذاكرة بشكل كبير دون التأثير على الدقة، ما قد يغير طريقة تشغيل النماذج مستقبلًا.

تفاصيل الخبر

قدمت Google من خلال قسم الأبحاث لديها تقنية مبتكرة تهدف إلى تحسين كفاءة النماذج الذكية وتقليل تكاليف تشغيلها.

- تعتمد نماذج الذكاء الاصطناعي على تخزين سياق المحادثات، ما يؤدي إلى تضخم البيانات مع الوقت

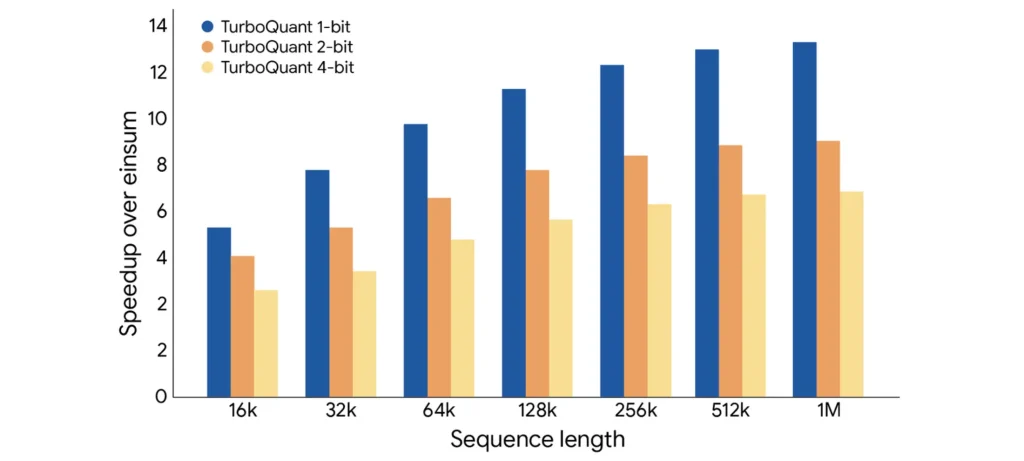

- تقوم تقنية TurboQuant بضغط هذا المخزون بأكثر من 6 مرات دون الحاجة إلى إعادة تدريب

- حافظت التقنية على دقة شبه كاملة حتى في اختبارات معقدة تحتوي على معلومات مخفية داخل نصوص طويلة

- حققت سرعة أعلى تصل إلى 8 مرات عند تشغيلها على معالجات Nvidia H100

- لم تتطلب التقنية أي تكلفة إضافية في التشغيل مقارنة بالطرق التقليدية

- تفوقت أيضًا في تقنيات البحث المتجهي المستخدمة في محركات البحث

- من المقرر عرض البحث رسميًا في مؤتمر ICLR 2026 خلال شهر أبريل

الأهداف المستقبلية

تعكس هذه التقنية توجهًا واضحًا نحو جعل الذكاء الاصطناعي أكثر كفاءة وأقل تكلفة، مع الحفاظ على الأداء العالي.

- تقليل الاعتماد على موارد الذاكرة باهظة الثمن

- تسريع استجابة الأنظمة الذكية في التطبيقات المختلفة

- دعم تشغيل نماذج أكبر على أجهزة أقل تكلفة

- تعزيز كفاءة محركات البحث القائمة على الذكاء الاصطناعي

- التأثير على سوق تقنيات الذاكرة وإعادة تشكيل أولويات الاستثمار

في النهاية، تمثل TurboQuant خطوة مهمة نحو تحسين البنية التحتية للذكاء الاصطناعي، وقد تفتح الباب أمام جيل جديد من النماذج الأكثر كفاءة والأقل تكلفة.