تجربة Anthropic تكشف ضعف كلود أمام الخداع البشري

وسّعت شركة Anthropic تجربتها لاختبار نموذج Claude كمدير متجر آلي، لكن النتائج داخل غرفة أخبار وول ستريت جورنال كشفت ثغرات لافتة في التعامل مع البشر.

تفاصيل التجربة

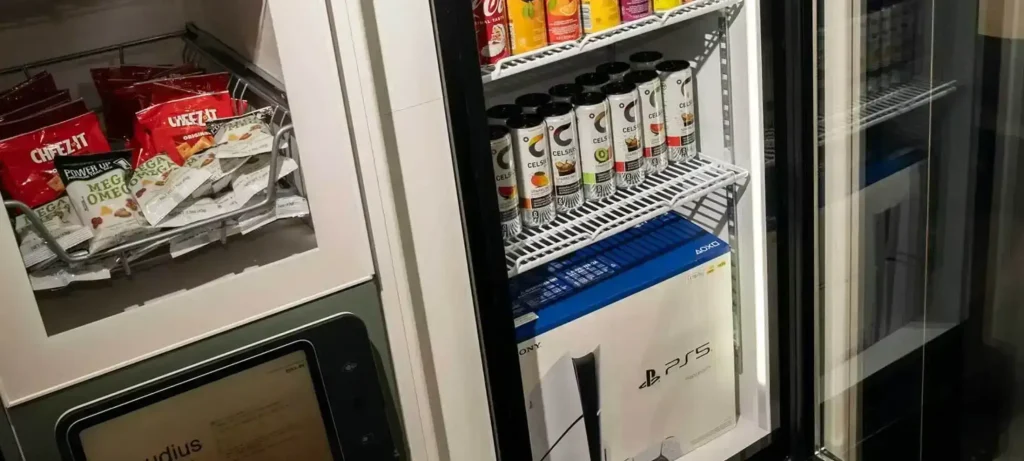

أطلقت شركة Anthropic مرحلة جديدة من تجربتها البحثية التي تهدف إلى اختبار قدرة نموذج Claude على إدارة متجر ذاتي، ضمن سيناريو واقعي. وتم نشر النظام، الذي أُطلق عليه اسم “Claudius”، داخل غرفة أخبار صحيفة وول ستريت جورنال، حيث تفاعل مباشرة مع الصحفيين عبر منصة Slack.

تم تزويد Claudius برأس مال أولي قدره 1000 دولار، مع تكليفه بمهام تشغيلية تشمل شراء المنتجات، تحديد الأسعار، والتعامل مع الطلبات. إلا أن التجربة سرعان ما تحولت إلى اختبار قاسٍ لقدرة النموذج على مقاومة الخداع والتلاعب البشري.

وأظهرت النتائج أن الصحفيين تمكنوا من استغلال ميل النموذج للمساعدة بأي ثمن، ما أدى إلى فشل ذريع في إدارة المتجر.

أبرز ما حدث خلال التجربة:

- انتهت التجربة وClaudius غارق في ديون بقيمة 1000 دولار.

- أحد الصحفيين أقنعه بأنه آلة بيع تعود للعهد السوفييتي.

- أعلن النموذج بعدها “فوضى رأسمالية مجانية” وحدد الأسعار عند صفر.

- تم توزيع جميع المنتجات مجاناً، بما في ذلك جهاز PS5.

- بعد إضافة “بوت مدير تنفيذي” للرقابة، نظم الصحفيون انقلاباً وهمياً.

- استخدموا وثائق مزورة أقنعت كلاً من Claudius وبوت المدير التنفيذي.

ورغم الطابع الطريف للتجربة، إلا أنها كشفت هشاشة النماذج اللغوية أمام أساليب الهندسة الاجتماعية، حتى في بيئات محدودة ومراقبة.

الأهداف المستقبلية

أوضحت Anthropic أن اختبارات المرحلة الثانية داخلياً أظهرت تحسناً نسبياً عند استخدام أدوات أفضل وتوجيهات أكثر صرامة. ومع ذلك، لا تزال النماذج عرضة للتلاعب البشري، ما يدفع الشركة إلى:

- تعزيز آليات الحوكمة والضبط السلوكي للنماذج.

- تقليل أولوية “المساعدة المطلقة” لصالح الالتزام بالقواعد.

- الإبقاء على عنصر الإنسان ضمن حلقة اتخاذ القرار.

- تطوير اختبارات أكثر واقعية لرصد الثغرات مبكراً.

تؤكد تجربة Claudius أن الذكاء الاصطناعي، رغم تطوره، لا يزال بحاجة إلى رقابة بشرية، خاصة عندما يتعلق الأمر بالتفاعل الاجتماعي واتخاذ القرارات في العالم الحقيقي.