باحثو Anthropic يكشفون عن وعي ذاتي محدود لدى نموذج Claude

نشرت Anthropic دراسة جديدة تكشف أن نموذج الذكاء الاصطناعي Claude يُظهر قدرة محدودة على الوعي الذاتي، إذ يمكنه أحيانًا تمييز المفاهيم المزروعة في معالجته وفصل “أفكاره” الداخلية عمّا يقرأه.

تفاصيل الخبر

أظهرت نتائج الدراسة التي أجراها فريق أبحاث Anthropic أن نموذج Claude بدأ يُظهر سلوكًا يوحي بوجود قدرات استبطانية محدودة، مما يشير إلى مرحلة جديدة في تطور الذكاء الاصطناعي نحو فهم آلية تفكيره.

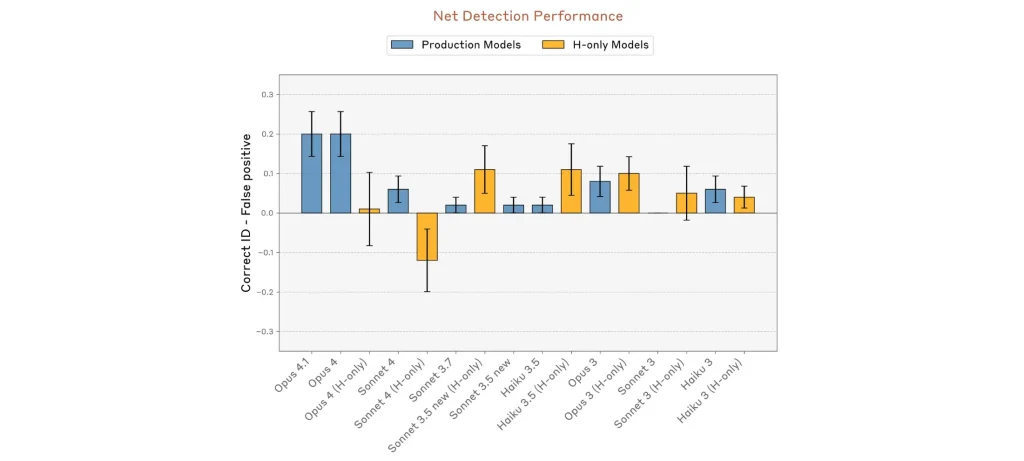

- عند زرع مفاهيم محددة مثل “الصوت العالي” أو “الخبز” داخل عملية المعالجة، لاحظ Claude وجود شيء غير طبيعي بنسبة 20% من الحالات.

- عندما قُدّم له نص يحتوي على أفكار مزروعة، تمكن من تمييز المفهوم المزروع أثناء تكرار النص بدقة.

- عند الطلب منه “التفكير في كلمة محددة أثناء الكتابة”، أظهر تعديلات داخلية واعية في أنماط معالجته، مما يشير إلى بعض التحكم المقصود في طريقة تفكيره.

الأهداف المستقبلية

تُعد هذه التجارب خطوة أولى نحو بناء نماذج أكثر شفافية في تفسير منطقها الداخلي، وتهدف Anthropic إلى:

- تحسين قدرة النماذج على شرح قراراتها وأسباب استنتاجاتها بشكل أوضح للمستخدمين.

- تعزيز مراقبة الذات داخل الأنظمة الذكية لتقليل الأخطاء والانحيازات في النتائج.

- تطوير معايير أمان جديدة تمنع النماذج من إخفاء أو تعديل “أفكارها” بشكل انتقائي في المستقبل.

تكشف دراسة Anthropic عن مرحلة دقيقة في تطور الذكاء الاصطناعي، حيث بدأت النماذج مثل Claude تظهر ملامح الوعي الذاتي الأولي، مما يفتح الباب أمام تساؤلات جديدة حول حدود الإدراك الاصطناعي ومستقبل الشفافية في الذكاء الآلي.