اختراق Vercel بسبب أداة ذكاء اصطناعي مرتبطة بجوجل

شهدت منصة Vercel حادثة أمنية لافتة في أبريل 2026، حيث أدى اختراق أداة ذكاء اصطناعي خارجية إلى تسلل غير مصرح به لبعض أنظمتها، ما أثار تساؤلات حول أمن التكاملات الرقمية الحديثة.

تفاصيل الخبر

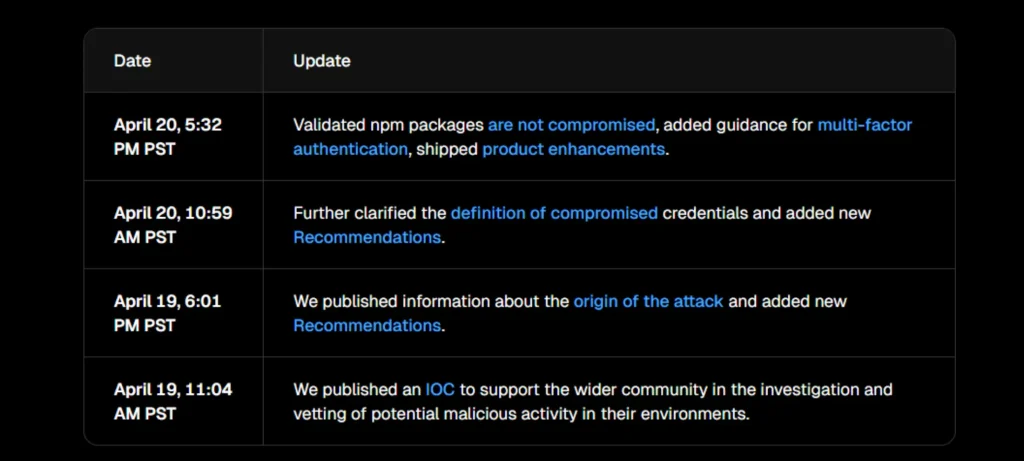

بدأت الحادثة نتيجة اختراق أداة خارجية تُدعى Context.ai، والتي كانت مرتبطة بحسابات Google Workspace لأحد موظفي الشركة، ما أتاح للمهاجمين الوصول إلى بعض الأنظمة الداخلية.

- تمكن المهاجم من السيطرة على حساب الموظف عبر OAuth، وهو ما فتح الباب للوصول إلى بيئة العمل الداخلية.

- تم الوصول إلى متغيرات بيئية غير حساسة (مثل مفاتيح API أو رموز الوصول غير المحمية).

- أكدت الشركة أن المتغيرات المصنفة “حساسة” لم يتم اختراقها بفضل آليات الحماية الخاصة بها.

- التحقيقات لا تزال جارية لتحديد مدى تسريب البيانات بشكل دقيق.

- تعاونت الشركة مع جهات أمنية مثل Mandiant للتحليل والاستجابة للحادث.

- تم التأكيد على أن الحزم البرمجية عبر npm لم تتأثر، ما يعني أن سلسلة التوريد البرمجية ما تزال آمنة.

كما أشارت التحقيقات إلى أن الهجوم على Vercel كان متطورًا للغاية، مع فهم عميق لبنية الأنظمة الداخلية، مما يعكس تصاعد مستوى التهديدات المرتبطة بأدوات الذكاء الاصطناعي.

الأهداف المستقبلية

في ضوء هذا الحادث، تسعى Vercel إلى تعزيز منظومتها الأمنية وتقليل المخاطر المستقبلية من خلال:

- فرض تفعيل المصادقة متعددة العوامل لجميع المستخدمين.

- جعل المتغيرات البيئية الحساسة الخيار الافتراضي عند الإنشاء.

- تحسين أدوات مراقبة النشاط واكتشاف السلوك غير الطبيعي.

- تعزيز إدارة الصلاحيات داخل الفرق بشكل أكثر دقة.

- رفع مستوى التوعية الأمنية حول مخاطر التطبيقات الخارجية والتكاملات.

وتؤكد هذه الخطوات على توجه الشركات التقنية نحو بناء أنظمة أكثر أمانًا في ظل الاعتماد المتزايد على أدوات الذكاء الاصطناعي.

في النهاية، يكشف هذا الهجوم على Vercel أن نقطة ضعف واحدة في أداة خارجية قد تكون كافية لفتح ثغرة كبيرة، ما يجعل الأمن السيبراني مسؤولية مشتركة بين الأدوات والمنصات والمستخدمين.