إطلاق نموذج OpenAI Privacy Filter لحماية البيانات الشخصيةجدا

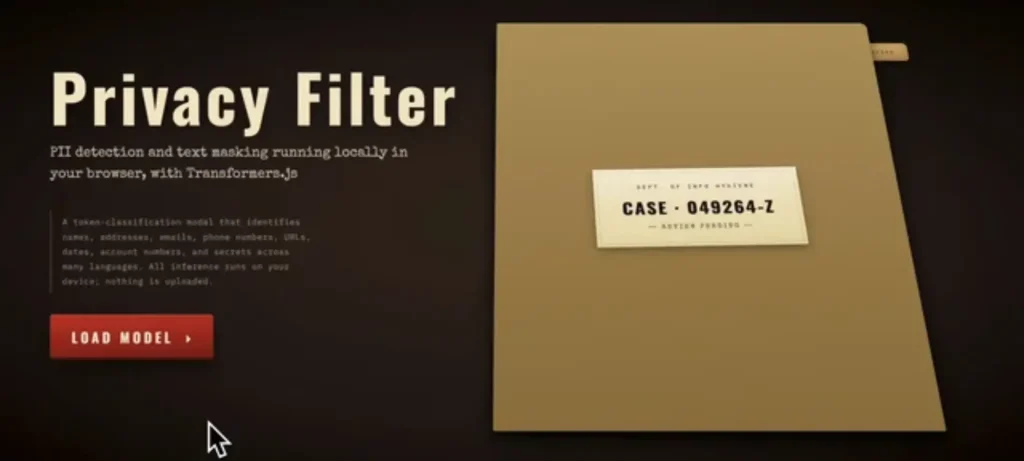

أطلقت شركة أوبن أيه آي نموذجاً جديداً باسم Privacy Filter يهدف إلى كشف وإخفاء البيانات الشخصية داخل النصوص قبل استخدامها في التدريب أو المشاركة، مما يعزز الخصوصية ويقلل مخاطر تسرب المعلومات مع تصنيف دقيق للكيانات وحماية عالية AI

تفاصيل الخبر

Privacy Filter الجديد من OpenAI يمثل خطوة مهمة في مجال حماية البيانات داخل أنظمة الذكاء الاصطناعي، حيث تم تصميمه ليعمل بكفاءة عالية على معالجة النصوص الكبيرة واكتشاف المعلومات الحساسة مثل الأسماء والعناوين وأرقام الهواتف.

- يعتمد النموذج على بنية Transformer متقدمة مخصصة لتصنيف التوكنات

- يحدد 8 فئات رئيسية للبيانات الشخصية مثل البريد الإلكتروني والعنوان والهوية

- يستخدم أسلوب BIOES لتحديد حدود البيانات الحساسة بدقة

- يمكن تشغيله محلياً دون الحاجة إلى رفع البيانات للسحابة

- يدعم معالجة نصوص طويلة تصل إلى 128 ألف توكن

- يتيح التحكم في مستوى الدقة بين تقليل الأخطاء أو زيادة الاكتشاف

كما يركز النظام على الاستخدامات المؤسسية مثل تحليل البيانات قبل تدريب النماذج، أو تنظيف قواعد البيانات من المعلومات الحساسة، مع إمكانية تخصيصه عبر إعادة التدريب وفق احتياجات كل جهة.

الأهداف المستقبلية

تهدف OpenAI من نموذج Privacy Filter إلى توسيع قدرات حماية الخصوصية في أنظمة الذكاء الاصطناعي، مع التركيز على الاستخدامات العملية في المؤسسات الكبرى.

- تحسين دقة اكتشاف البيانات الحساسة عبر لغات متعددة

- تطوير نماذج أكثر مرونة للتعامل مع سياسات خصوصية مختلفة

- تعزيز الأداء في البيئات عالية الحساسية مثل الصحة والمال

- تقليل الاعتماد على المعالجة السحابية وزيادة التشغيل المحلي

- دعم تكامل النموذج مع أنظمة الذكاء الاصطناعي التوليدية

كما يُتوقع أن يسهم النموذج في وضع معيار جديد لمعالجة البيانات قبل تدريب النماذج الكبيرة، مما يقلل المخاطر القانونية والتنظيمية المرتبطة باستخدام البيانات الشخصية.

يمثل Privacy Filter خطوة متقدمة نحو بناء أنظمة ذكاء اصطناعي أكثر أماناً ووعياً بالخصوصية، مع إمكانيات واسعة لتطبيقه في مختلف القطاعات الحساسة.