إطار ذكاء اصطناعي جديد يحاكي الفيزيولوجيا لفهم المشاعر البشرية

طور باحثون في اليابان نموذجاً حاسوبياً يحاكي كيفية تكوّن المشاعر البشرية، باستخدام بيانات جسدية وحسية متعددة، ما يمكّن الذكاء الاصطناعي من فهم تجارب المشاعر بشكل أقرب للطبيعة البشرية.

تفاصيل البحث

اعتمد الفريق البحثي من NAIST وOsaka University على نظرية المشاعر البشرية المُنشأة، التي ترى أن المشاعر ليست ردود فعل فطرية بل تُبنى في اللحظة من خلال الدمج بين الإشارات الداخلية للجسم والمعلومات الحسية الخارجية.

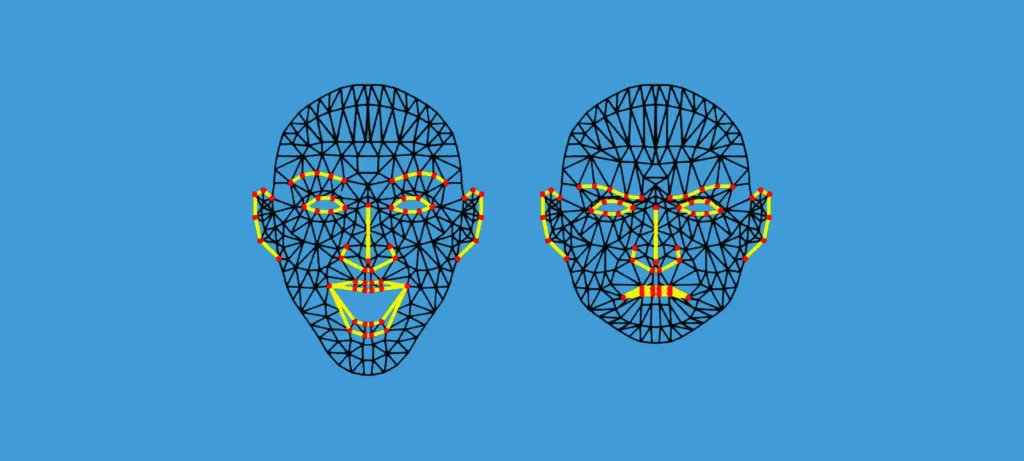

- استخدم الباحثون نموذج mMLDA متعدد الطبقات ومتعدد الوسائط لاكتشاف الأنماط الخفية في البيانات دون إعطاء تسميات مسبقة للمشاعر.

- شارك 29 شخصاً في الدراسة، تعرضوا لـ 60 صورة مثيرة للمشاعر، بينما سجل الباحثون استجابات فيزيولوجية مثل معدل ضربات القلب، إلى جانب الوصف اللفظي لتجاربهم.

- قام النموذج بتحليل تزامن المعلومات البصرية، الجسدية، واللفظية لبناء مفاهيم عاطفية خاصة به.

- عند مقارنة تصنيفات النموذج مع تقييمات المشاركين، وصلت نسبة الاتفاق إلى حوالي 75%، ما يشير إلى تطابق كبير مع الخبرة البشرية.

- النموذج قادر على استنتاج حالات عاطفية يصعب على الأشخاص التعبير عنها بالكلمات، ما يجعله مفيداً في الصحة النفسية والرعاية المساندة.

الأهداف المستقبلية

هذا البحث يفتح آفاقاً لتطوير أنظمة ذكاء اصطناعي أكثر حساسية عاطفياً وقادرة على التفاعل بطريقة المشاعر البشرية:

- تمكين الروبوتات والتطبيقات الذكية من فهم المشاعر في سياقات تفاعلية متنوعة.

- دعم المراقبة الصحية والتدخل المبكر في حالات التوتر النفسي أو اضطرابات النمو.

- تحسين التقنيات المساعدة لمرضى الخرف أو الأشخاص ذوي الاحتياجات الخاصة.

- ربط النظريات العاطفية البشرية بالتحقق التجريبي عبر الذكاء الاصطناعي.

- تعزيز قدرة النماذج على التعامل مع المشاعر الدقيقة وغير المعلنة.

من خلال محاكاة تكوين المشاعر البشرية، يضع هذا الإطار الأساس لأنظمة ذكاء اصطناعي أكثر إدراكاً عاطفياً، مما يعزز التفاعل بين الإنسان والآلة ويقدم فرصاً جديدة في الصحة والتقنيات المساندة.